(圖/取自網路)

1月28日,《自然》雜誌報導了谷歌開發團隊GoogleDeepMind的新圍棋AI——AlphaGo在沒有任何讓子的情況下以5:0完胜歐洲冠軍樊麾的新聞;同時,AlphaGo也擊敗了目前最好的圍棋程序中99.8%的對手。

自「深藍」在1997年第一次代表國際象棋AI擊敗頂尖人類選手後,AlphaGo也成為了人類歷史上第一次在公平比賽中戰勝職業選手的圍棋AI。

由於相較於其他棋類的複雜性,圍繞圍棋的AI在很長一段時間甚至連業餘棋手都無法戰勝。但Google所研發的AlphaGo卻通過機器學習的方式完成了對人類的逆襲。如果今年3月份AlphaGo繼續擊敗李世石的話,被譽為「人類智力試金石」的圍棋也將作為人類智力的最後堡壘被AI攻破。

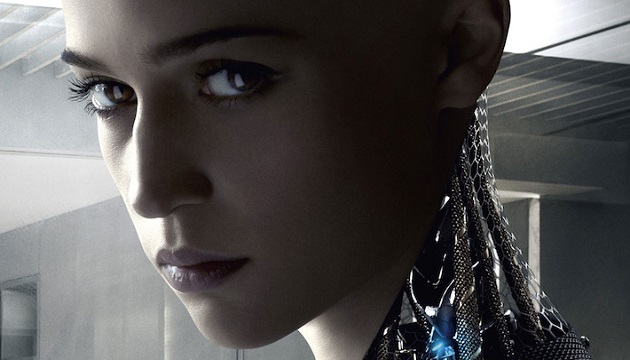

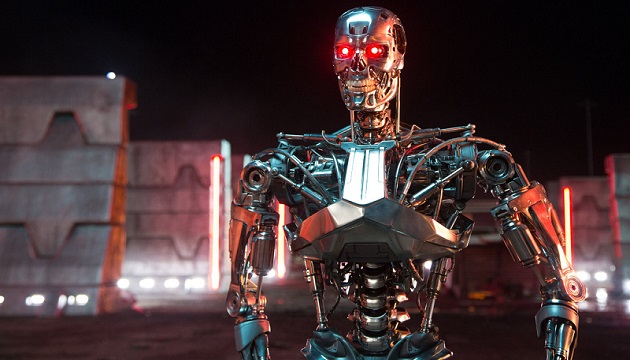

當機器人學會自行思考,我們面對的究竟是下一個個人電腦還是人類殺手?

從窮舉到自行判斷,機器人學會自己思考

1997年,當IBM深藍計算機在國際象棋的比賽中擊敗人類時,它使用的是「窮舉法」,即窮盡所有可能的步法來完成棋局。但在圍棋AI中,「窮舉法」顯然沒有那麼可行。

在國際象棋的每一個回合,平均可能的走法有35種,但圍棋的走法卻能達到近250種。此外,在這250種可能的走法之後,還對應著另外250種可能,這是一個超越了「窮舉法」所能承受的範圍。

圍棋有361個眼位,分黑白兩種棋子。在棋盤上下棋,所有可能的局面加在一起是個相當驚人的數量,這個數字比全宇宙的原子總數加起來還要多得多。

領導這項研究的Google研發人員DavidSilver說道:

「圍棋有著巨大的搜索空間,用蠻力很難解決。AlphaGo的關鍵在於,將搜索空間縮小到可以操作的範圍。這個方法讓AlphaGo比以前的方法都更像人類。」

(圖/取自網路)

AlphaGo的核心是兩種不同的深度神經網絡——「策略網絡」(policynetwork)和「價值網絡」(valuenetwork)。它們通過相互配合來計算出相對有優勢的步法並摒棄差棋,從而將計算量控制在計算機可以完成的範圍裡。

在「價值網絡」中,AI會一邊推算一邊判斷局面,當局面處於明顯劣勢的時候,機器便會就直接拋棄某些路線;而「策略網絡」則負責減少搜索的寬度,將那些棋步是明顯不該走的放棄並避免無端送子給對手吃。通過將這些信息放入一個概率函數,AI便可以重點分析優勢的步法而不用給每一步以同樣的重視程度。

這種「思考」的方式本質上和人類棋手所做的一樣。與之不同的是,人類在長時間的比賽后難免會因為疲勞而犯錯,但機器不會。而且機器能通過每天近100萬局的訓練來不斷提高,而精力的限制卻似乎只能讓人類隨著時間的積累而束手就擒。

與此同時,GoogleDeepMind團隊還採用了「監督學習」(supervisedlearning)的方式讓AI和自己進行對弈,這種「強化學習」(reinforcementlearning)的方法也能讓AI長期處於高水平的對抗中。這也被搜狗CEO王小川稱為AlphaGo最可怕的一點。

「AlphaGo還不只是從互聯網上去收集數據進行學習,更可以自己和自己下,實現自學習。看過電影超驗駭客沒有?人工智能可以做到隨著時間的推移就能更加聰明。金庸小說中老頑童讓自己左手和右手打架左右互搏,成為天下無敵的武功,那個只是故事。在下棋這個領域,AlphaGo有這樣的設計,讓這種武功成真了!往下還有兩個月的時間,AlphaGo這樣一台算法上沒有天花板的機器,很有機會在左右互搏下登峰造極,成為不可超越的圍棋高手。」

(圖/取自網路)

機器會像刪除垃圾郵件那樣將人類幹掉?

上世紀90年代,MarkWeise說過:「最深奧的技術是那些感覺不到存在的技術,這些技術自如地融入到日常生活中,不知不覺成為生活的一部分。」在過去二三十年裡,個人電腦已經做到了這一點,而在未來的幾十年裡,下一個能做到這一點的可能就是機器人。

在GIF2016的演講中,MIT計算機科學與人工智能實驗室總監DanielaRus也曾提到:

在智能手機上,我們的每一種需求幾乎都可以找到一款對應的App,未來的機器人可能也會是這樣,我們可以為自己的每一個需求都「製造」出一個機器人,機器人會變得像現在的手機App這樣普遍。

但是,隨著AI技術的進步,有關「人工智能威脅論」的討論也日益激烈。

ElonMask曾多次表示,「如果讓我猜人類最大生存威脅,我認為可能是人工智能。因此我們需要對人工智能保持萬分警惕,研究人工智能如同在召喚惡魔。也許機器人會覺得刪除垃圾郵件的最好辦法是把人類一起幹掉。」

為此,他也和矽谷著名創業孵化器YCombinator的總裁山姆·奧特曼共同創建了人工智能公司OpenAI,寄希望於將開源其研究成果分享給研究人工智能的每一個人,並通過對行業的監管來將那些帶有邪惡意圖的過度研究扼殺於搖籃。

(圖/取自網路)

但Google卻不認同這種對意圖的揣度,在去年的Google亞太區媒體會議上,Google前CEOEricSchimidt曾表示,

「我不認為讓計算機模仿大腦可以做人工智能,因為人類大腦的神經元太多太複雜了,我們只能讓機器去學習。大腦會自己去過濾一些信息,這樣的概念可以利用到機器學習上,但我並不認為人工智能和人的大腦一樣,它只是藉助了人腦的一些功能概念。

人類是正義的,機器是邪惡的?我不認為是這樣,這只存在於電影中。現在人類造的都是好的機器人,而不是像少數派報告中的那樣。幫我打掃廚房的機器人,這其實是人類最需要的機器人。但其實很難。 」

機器能像人一樣學到道德倫理嗎?最簡單的方式是讓機器盡可能地多去學習,許多無人駕駛汽車都是基於這種,訓練車用人的方式去開車。在倫理道德這個問題上,我們可以製定一些規則,比如說設定一些標誌提醒它,按人的方式去行為。

正如DeepMind創始人DemisHassabis所言,「最終,我們想要將這些技術應用到真實世界的重要問題中。因為我們用的方法是通用的,我們希望有一天,它們能延伸得更廣,幫助解決最緊迫的社會問題,從醫藥診斷到環境模型。」

資訊來源:IT時代

【101傳媒/整理報導】

-------------------------------------------------------

文章內容若有侵權疑慮,請來信告知。

客服信箱:[email protected]

免責聲明:

部分圖片、觀點,來源於網際網路及其他網路平台,主要目的在於分享訊息,讓更多人獲得需要的資訊,其版權歸原作者所有。如涉及侵權請告知,我們會在24小時內刪除相關內容。